- Vitalik Buterin a souligné les risques spécifiques de l’AGI, appelant à des solutions ciblées pour une adoption technologique sécurisée.

- Le co-fondateur d’Ethereum a plaidé en faveur de la décentralisation et de l’auto-garde pour sauvegarder les écosystèmes de cryptographie et d’IA.

En tant qu’investisseur chevronné en crypto avec une décennie d’expérience dans un paysage numérique en constante évolution, les récentes idées de Vitalik Buterin sur les risques AGI me touchent profondément. Ses expériences de vie ont joué un rôle déterminant dans l’élaboration de sa vision de la technologie, et l’accent mis sur des vecteurs d’attaque spécifiques plutôt que de considérer l’AGI comme une entité abstraite semble être une approche pratique.

Les discussions sur la réalisation de l’intelligence générale artificielle (AGI) ont repris une fois de plus avec le dévoilement du nouveau modèle d’OpenAI, nommé O3.

En tant qu’investisseur en crypto, je suis enthousiasmé par les progrès remarquables réalisés par O3, obtenant un impressionnant 87,5 % sur l’indice de référence ARC-AGI. Cette référence est cruciale pour mesurer les progrès vers l’intelligence artificielle générale, et cette réalisation représente une avancée significative dans le développement de l’IA.

Cependant, parallèlement à cet enthousiasme, des inquiétudes persistent quant aux risques potentiels que l’AGI pourrait poser si elle dépasse les capacités cognitives humaines.

Buterin sur les risques potentiels d’AGI

S’exprimant sur le sujet, le co-créateur d’Ethereum, Vitalik Buterin, a exprimé ses inquiétudes concernant les dangers possibles que pourrait engendrer l’intelligence générale artificielle (AGI).

Sur X, Buterin a partagé des réflexions importantes sur les voies potentielles de développement de l’IA qui pourraient conduire à une évolutivité et une acceptation généralisée.

Il a souligné l’importance de relever les défis importants que l’AGI pourrait poser à mesure qu’elle s’intègre davantage dans les applications grand public.

Il a noté,

Dans ce contexte, Buterin soutient que traiter l’AGI (Intelligence Générale Artificielle) comme une force indomptable et intangible est une erreur. Au lieu de cela, il souligne l’importance de se concentrer sur les vulnérabilités ou les points d’attaque identifiables lors de son développement et de son déploiement.

Il a en outre souligné les risques potentiels.

Il s’agit notamment de l’AGI exploitant les vulnérabilités logicielles, diffusant des informations erronées pour manipuler les humains, déployant des agents biologiques numériques, prenant le contrôle de l’infrastructure physique ou dépassant complètement l’intelligence humaine.

Comment tout cela a-t-il commencé ?

À la lumière des commentaires de Balaji concernant les progrès rapides des innovations technologiques, ses réponses ont déclenché de nouveaux débats autour des conséquences potentielles de l’évolution de l’intelligence générale artificielle (AGI).

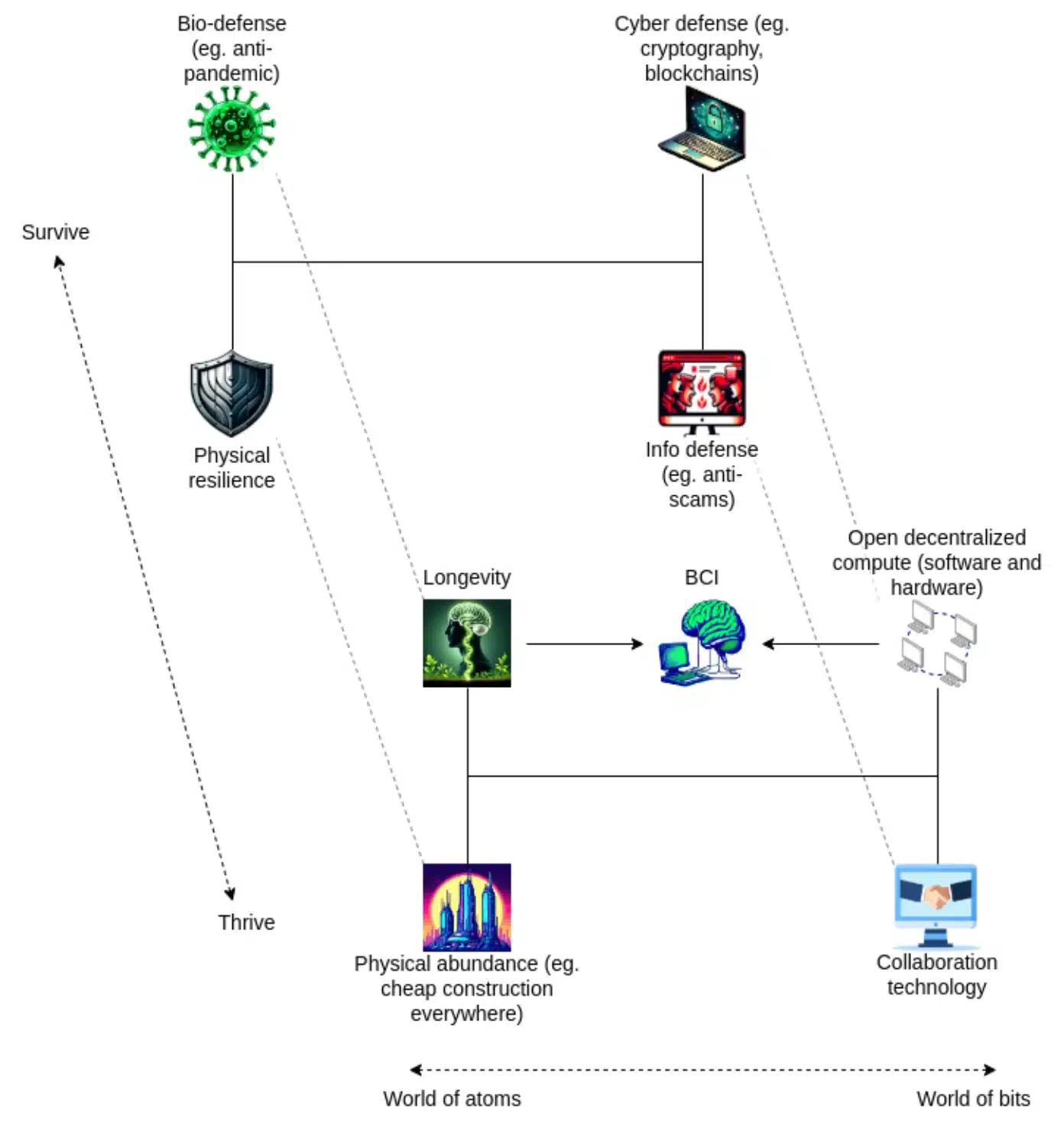

Dans la même discussion, Buterin a souligné que la crypto-monnaie n’est qu’un aspect d’un tableau plus vaste. Il a souligné son lien avec des stratégies plus larges visant la croissance et le développement.

En tant que chercheur, j’avais accès à un schéma détaillé qui juxtaposait avec élégance le domaine tangible des atomes au paysage abstrait des bits. Cette visualisation a permis de mettre en évidence l’interaction dynamique entre ces deux sphères distinctes.

Quoi de plus ?

Cependant, Buterin a souligné l’importance de protéger les technologies émergentes, soulignant que l’auto-conservation n’est pas un résultat courant dans l’environnement actuel des crypto-monnaies.

En outre, il a souligné les dangers potentiels d’une structure centralisée au sein des systèmes de crypto-monnaie et d’intelligence artificielle. Les utilisateurs dépendent souvent d’intermédiaires tels que les bourses, ce qui peut entraîner des faiblesses telles que des violations ou une mauvaise administration.

Soulignant les menaces potentielles provenant d’individus trompeurs, tels que des escrocs exploitant une technologie comme l’assistant IA d’Elon Musk, Buterin a proposé un système basé sur la décentralisation.

Cela a mis en évidence que le co-fondateur envisage un Internet artificiel des objets dans lequel les clés privées donnent aux utilisateurs un contrôle total, réduisant ainsi les attaques potentielles contre des technologies telles que les maisons intelligentes.

En conclusion, Buterin a fortement souligné que l’acceptation du grand public peut effectivement être obtenue, exhortant tout le monde à participer activement.

« Nous devons explicitement nous y efforcer. »

- EUR CHF PREVISION

- EUR USD PREVISION

- EUR JPY PREVISION

- EUR CAD PREVISION

- AUCTION PREVISION. AUCTION crypto-monnaie

- USD CAD PREVISION

- RARE PREVISION. RARE crypto-monnaie

- USD CHF PREVISION

- WELL PREVISION. WELL crypto-monnaie

- EUR VND PREVISION

2024-12-27 07:03